検索アプリは、実質的にあらゆるものを見つけるためのリファレンスとなっています。友人や家族から、私たちのデバイスや iCloud ファミリーのデバイスまで、 AirTag を配置したあらゆる要素を含みます。これを踏まえると、Apple が拡張現実の使用を含め、位置情報をさらに快適にする方法を考え、開発し続けていることは驚くべきことではありません。

すでに入手可能な情報には多くの可能性があります

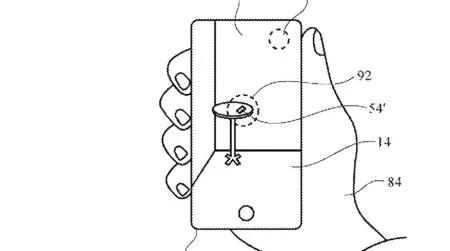

実際のところ、検索アプリの位置情報システムはすでに非常に直感的であり、画面中央の矢印が方向を示し、オブジェクトまでの距離が下部に表示されます。さらに一歩進んで、特許「 電子機器の追跡システム」では、物体の位置を特定するための「視覚補助」として定義されるものの使用を提案しています。

特許には「[iPhoneの]制御回路はディスプレイやその他の出力デバイスを使用して、ユーザーをアイテムに誘導する可能性がある」と記載されている。 「ディスプレイには、矢印、球、円、コンパス、地図、またはアイテムの方向をユーザーに示すその他の視覚補助などの視覚ガイドが表示される場合があります。」

「ディスプレイは、カメラで捉えたユーザー環境のライブ画像に視覚補助を重ねることができます」と彼は続けます。 「必要に応じて、制御回路は、電子機器が対象物の所定の範囲内に入るまで待ってから、カメラの電源を入れることができます。」

「電子機器と物体との間の距離が変化すると、制御回路は視覚補助装置のサイズやその他の特性を変化させることができます」と彼は言います。 「制御回路は、物体に対する電子機器の向きが変わると、画面上の視覚補助の位置を変更できます。」

真実は、 iOS 15マップ アプリのナビゲーション支援機能を見て、Apple マップからのデータと iPhone の環境認識機能を組み合わせて拡張現実でたどるべきルートを教えてくれる機能を見た後、検索アプリに似たシステムが存在するということです。かなり一貫したもの。

Apple が最近開発している多くのテクノロジーと同様に、このシステムは将来の拡張現実メガネにも非常によく適合します。 iPhone に搭載されるテクノロジーの多くは、私たちにとって日常的に役立つだけでなく、Apple がこれらの将来のメガネの基礎を開発し続けるのに役立つということについて、私たちはすでに何度かコメントしました。例えば写真に書かれた文字を認識する機能などは、将来的には非常に便利になるでしょう。

実のところ、検索アプリからオブジェクト、特に AirTags を見つけるには、すでにカメラが使用されています。これは、周囲の空間のコンテキストをより多く把握し、紛失したオブジェクトの位置をより正確に示すために行われます。このことを考えると、情報を組み合わせて拡張現実の形で画面上で見ることができるようになるのは時間の問題のように思えます。