先週月曜日の WWDC24 での Apple Intelligence のプレゼンテーションは、間違いなくエコシステムの転換点となりました。 Apple が最初に新しいテクノロジーを開発することはめったにありませんが、常に最高のものを探しています。彼らは自分のペースで行動し、場合によっては、今回のように、人工知能に興味がなさそうな印象を与えることもあります。

これ以上真実からかけ離れたものはありません。最近の発売では、 MacBook Air M3や最新のiPhone 15 Proなど、最新の Neural Engine を搭載した製品の技術的な AI 機能を強調しているのは Apple 自身です。実際、2017 年の A11 Bionic チップの登場以来、彼らはそれを行ってきましたが、結果は非常に特定のタスクに向けられたもののみでした。むしろ、非常に特殊な方法で「内部で」機能したものに近いものでした。

Apple Intelligence は新しい機能ではありません。これは、オペレーティング システムとエコシステムの大幅な変革であり、それらすべてに横断的に影響を及ぼし、この第 1 世代では、A17 Pro プロセッサ以上と M1 以降の Apple Silicon を搭載したデバイスから始まります。

Apple Intelligence、重要なデータ

私は Apple Intelligence の動作を見る機会がありましたが、まず、Apple が生み出した人工知能の可能性と定義をより深く理解するために強調したいいくつかの基本的な概念を見てみましょう。

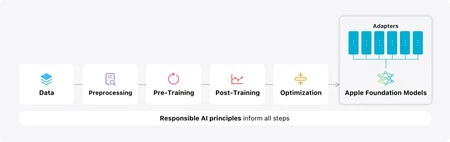

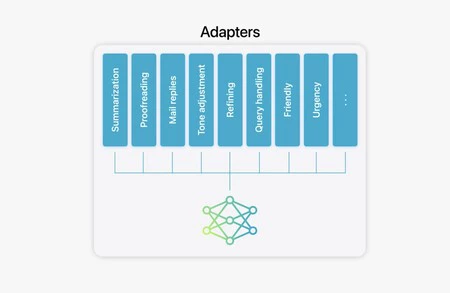

- Apple Intelligence は、300 億を超えるパラメータの大規模な言語モデルに基づいており、特定のタスクを対象とするために Apple 自体が洗練、厳選、完成させたものです。これらのタスクは、デバイス上の情報の応答と処理を担当する「アダプター」と呼ばれるコントローラーに結果を集中させます。

- アダプターはシステムのニーズに応じて動的に変化するため、各アダプターの情報を動的に変更でき、新しい使用例が発生した場合に新しいアダプターに簡単に拡張できます。

- 洗練されたモデルは、デバイス自体の約 30 億パラメータのローカル モデルにダウンロードされ、ローカルで使用できるようになります。これらのローカル モデルは、デバイスの内部ストレージ上で現在のオペレーティング システムよりも多くのことを占有することはないようです。

- デバイスに保存されている個人データの使用に関連するタスクを担当するのは、これらのローカル モデルです。このようにして、結果を得るために情報をすべてサーバーに送信または「アップロード」する必要はありません。

- より大きなコンピューティング能力を必要とする、またはより多くのパラメーターを含む言語モデルを必要とする特定のプロセスでは、情報の断片が Apple Intelligence Private Cloud に送信されます。

- これらの情報は匿名化および暗号化されており ( Apple ですら見ることができません)、このより複雑な応答を処理して返すために必要な最小限の情報が含まれています。応答が送信されるとき、データはこの新しい Apple Intelligence クラウドには保存されません。

- Apple がプライベート クラウドを使用してユーザーの個人データをサポートされていないデバイスにアップロードするという噂は真実ではありません。Apple はすべての個人データをデバイスから保存することはありません (さらに、仕様により、これらのリクエストの結果さえもサーバーに保存されません) )。

- Apple Intelligence の設計は 100% このテクノロジーに基づいており、機能するために ChatGPT を使用しません。ただし、Apple は、個人データが必要ないタスク (処方箋を作成する、何かを修理する… ) や、特定の知識分野 (医学、工学モデルなど)でトレーニングされたユーザーを支援できる、より大きな言語モデルが他にも存在することを理解しています。 )確固たる専門知識を持っています。

- ChatGPT は Apple Intelligence への単なる追加アドオンであり、オペレーティング システムのオプションからその使用を完全にブロックして、Apple Intelligence のみを使用し、他には何も使用しないこともできます。

つまり、Apple Intelligence は Apple が開発した新しい人工知能システムであり、独自にトレーニングされ厳選された言語モデルに基づいています。これはプライバシーと実用性を重視しており、ローカルのオンデバイス コンピューティングと最新のニューラル エンジンを組み合わせ、Apple Silicon に基づく新しいプライベート クラウドで処理される、より大規模で強力な言語モデルのサポートを組み合わせています。

個人的な背景、出発点

Apple Intelligence は、アプリを含む iPhone に保存されている個人データのコンテキストから始まります。そのデータセット全体は、私たちの質問を自然に理解するために使用されます。これは私が初めて目にしたテストの 1 つです。

私たちはApple Parkの一室でのデモに行きました。その木製のテーブルの上には、MacBook Pro、iPad Pro、iPhone 15 Pro、Apple Intelligence が動作する最初のデバイスが私の目の前にありました。このテクノロジーの正式リリースは2024 年後半に予定されています。会議を始める前に、私はそれらのデバイスを物理的に区別する何かが必要であるかのように見つめました。

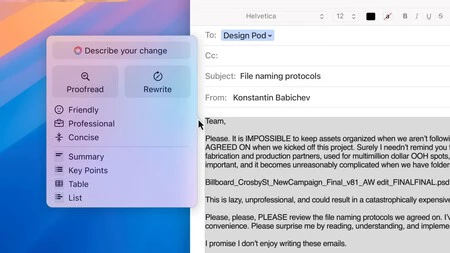

それらは明らかに私たちがすでに知っているものと同一でした。私たちは Mac でデモンストレーションを開始しました。メールでは、インテリジェントに書く能力がテストされました。リストから選択することでコンテキストと意味を変更できる電子メール。これらのオプションは自動的に表示され、開発者が標準のテキスト フィールドにコードを 1 行も触れる必要はありません。

これらのオプションのいずれかを選択すると、花火が始まります。文字通り、Apple は、私たちが AI で何かを作成または変更していることを理解するための独特の新しいインターフェイスを作成しました。テキストの文字の色が変化し、配置され始め、テキストに新しい意味が与えられました。ほぼ即時というレスポンスの速さに驚きました。

テキスト モードのオプションは結果に焦点を当てています。残りのテストでは、 Apple の目標はユーザーにとって役立つこと、つまり AI との会話で試行錯誤に迷わないことであることがわかりました。書き方の変更は、フレンドリー、プロフェッショナル、または簡潔から選択できます。これら 3 つのカテゴリは、日常生活に非常に適しているので、これら 3 つのカテゴリを選択する前に、内部で十分な議論のプロセスがあったと私は確信しています。

要約を作成し、要点を抽出し、表やリストに変換することもできます。 AIにレビューしてもらうか、完全に書き換えてもらいます。これらのオプションが機能しない場合でも、問題はありません。変更を説明すれば、システムが変更を行ってくれます。

何度かテストを行った結果、応答の速さだけでなく、その正確さにも驚きました。 「偽りの言葉」はなく、幻覚や適合しないものはありませんでした。すべてが非常によく制限され、元の文脈に従って焦点が絞られていました。

画像でも同様のことが起こります。これは同社にとってデリケートな点でした。彼らは制御されていない AI の結果で問題に陥るはずがないため、言語モデルは極限までトレーニングされ、厳選されています。

画像では 3 つのテストを確認できました。最初のテストはGenmoji生成です。これは期待どおりに機能します。探したいものを記述すると、結果の 3 つのバリエーションが即座に表示されます。この源文字はステッカーとして届くので、iOS 18 を持っていない人でも誰にでも送ることができます。

Image Playground 部分は非常に興味深く、より強力です。 Apple のモデルでは、フォトリアリスティックな画像は許可されていません。おそらく、AI によって作成された実際の画像を使用することによって引き起こされる可能性のある問題を回避するためです。代わりに、アニメーション、イラスト、スケッチの 3 つの作成スタイルから選択できます。

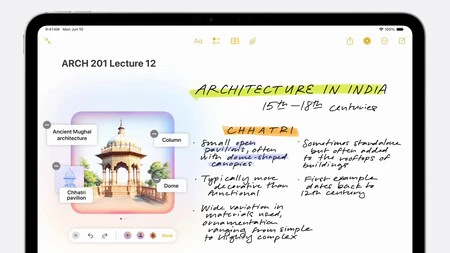

Image Playground は、説明に基づいて画像を生成するために使用されますが、さらに興味深いのは、私が見た証拠です。Freeform ページ上の寺院のスケッチは、Apple Pencil を使用してスケッチを丸で囲むだけで、即座に完全に作成された画像に変換されました。彼は、寺院を不器用に表現しようとした線を理解しただけでなく、ページの残りの部分を読んで、そこにあるべきものを理解し、それを作成しました。たとえば、フリーフォーム シート、Mail 内の電子メール、または基調講演プレゼンテーション (およびその他の多くのケース) が可能です。とても印象的です。そしてまた驚くべきスピードで。

私たちが見たもう 1 つの例は、写真に「過剰に」写っている人物を削除する典型的な「フォトボム」です。その人を指すだけで、その人は消えます。以前いた場所には痕跡、痕跡、人工物は何も残りません。しかし、印象に残っているのはこれではありません。私が最も気に入ったのは「自分でやる」モードです。 Apple Intelligence に写真を改善するよう指示します。 AI は写真をレビューし、誰が前景にいてカメラを見ているかを理解し、誰がお互いを知っているか、またはその主役であるかを理解します。それから彼女は?余分な人物を消去し、写真のパラメータを強化しました。数秒以内に。

この威力を引き続き理解するには、私たちが見たものはすべてデバイス上でローカルに処理され、プライベート サーバーを呼び出すことはありません。テキスト理解の特定かつ非常に特殊な場合にのみ、クラウドが呼び出されます (テキストが非常に複雑な場合)。画像の場合は、常にローカルで処理されます。ここに、私がコンセプトとして気に入ったものがあります。Apple Intelligence は、ローカル モデルに基づいており、デバイスに接続がない場合でも (たとえば、接続のない飛行機上など) 完全に使用できます。これは、次の機能を使用するためです。 Neural Engine NPU はすべてローカルで処理します。

Apple Intelligence を備えた Siri は、私たちが夢見ていた Siri よりもさらに優れているようです

私たちの旧友である Siri が完全に新しくなった新機能を理解したとき、私は文字通り言葉を失いました。現在のデバイスで知っていることは忘れてください。今では、デバイスからの情報を使用して、ほぼすべての質問に、まったく自然な方法で答えることができます。

そして、私は単に答えについて話しているのではありません。また、私たちが物事を求める方法についても説明します。 Apple 担当者が iPhone 15 Pro のサイドボタンを押して Siri を呼び出したところ、そこから画面の残りの隅に波のように光が現れました。 Siri と話しているときに、彼は意図的に間違いを犯しました (質問はこれと似ていました): 「ねえ Siri、マリアにメッセージを送ってほしいのですが、コンサートに遅れそうなことを伝えてください。」先日、私を招待してくれました。「すみません、代わりにホルヘに送って、時間通りに到着するように努めると伝えてください。」これに対する現在の Siri の反応を想像できますか?

しかし、Apple Intelligence を備えた Siri は、ユーザーのメッセージをレビューし、誰が私たちを招待したのか、マリアとホルヘのどちらのことを指しているのか、メッセージと受信者に関して何を変更する必要があるのかを 1 つで認識していたため、ユーザーがどのコンサートについて言及しているのかを認識していました。実際の人間と話すのと同じように、文を実行します。 Siri AI は「カレンダーにリマインダーを追加してください」というコンテキストを理解しているため、続行できます。そして、明日もう一度彼に尋ねたら、彼はこの会話を覚えていて、それに基づいて行動するでしょう。

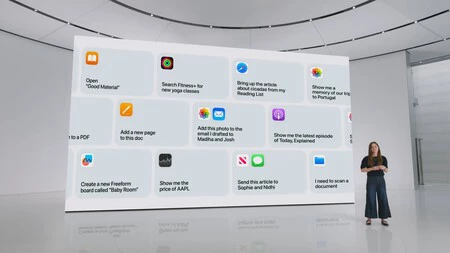

Apple Intelligence は、新しいオペレーティング システムの新しい機能ではありません。これは、これらすべての中心となる重大な変更であり、これらの言語モデルをシステム レベルで統合し、これらすべての機能を「すぐに使える」状態で提供します。開発者がそれらを最大限に活用したい場合は、この WWDC24 を開始することで、そのためのツールが提供されます。これらは App Intent と呼ばれ、これらのアプリと AI およびシステムの残りの部分との相互関係を可能にします。

たとえば、Siri に「先日姉が送ってくれた写真を撮って、下書きにあるメールに追加して」と頼むと、 Apple Intelligence はプレビュー アプリ エンジンを使用して画像を取得し、トリミングしたり、補正したりします。必要に応じて、電子メールを使用して、要求された電子メールを検索し、写真を投稿します。すべては「内部」で行われます。つまり、アプリケーション間のプロセスを受け入れたり、それに従ったりするための介入が必要なボタンはありません。

明らかに非公開の内部テスト中であるにもかかわらず、デモが非常にダイナミックであることが気に入りました。それはスクリプト化されたものではなく、私たちに機能を見せていた Apple の人は、何かが機能するかどうかについて質問があるとき、たとえば新しい Siri に実際の結果を確認するよう求めました。クラッシュしたことも、奇妙な結果が返されたことも、問題が発生したこともありません。私の感覚では、これらすべては Apple が認識しているよりも準備が整っているように思えますが、Apple は発売には慎重になりたいと考えています。

このデモンストレーションはわずか 20 分程度でしたが、近い将来私たちの生活に一般的になるであろう未来の何かを明らかに見ていることがわかりました。 Apple の AI は、テクノロジー自体で感動を与えることを目指していたわけではありません。代わりに、強力でプライベートで責任感が高く、幻覚を回避し、信じられないほど実用的で便利なものを作成しました。明らかに、ここでテストしたユースケース以外にも何千ものユースケースがありますが、正直なところ、現在はほぼすべてが可能であるように思えます。

私たちの第一印象について詳しく知りたい場合は、今週、 Apple Park の Apple Podcast Studio で非常に個人的なポッドキャストを録音する機会がありました。コンテンツクリエイターのとジャーナリストのアンヘル・ヒメネス氏とともに、Apple Intelligence と WWDC24 の残りのニュースを見た後の意見をレビューします。このポッドキャストの最初の部分は今週の Las Charlas de IphoneFocus.clickのエピソードで、後半はBinarios de Angel のエピソードでご覧いただけます。

これらは未来の最初の数分間にすぎません。ここから進化する安定したよく考えられた出発点であり、非常にトレードマークのアプローチにより、私たちの期待を十分に満たしています。今後数か月以内に、最終バージョンまでにさらにいくつかの改善が行われる可能性があります。疑いもなく、これは私たちにとってのAI ( Macintosh の発売を記念して Apple が発表したもの) であり、私たちはこれからも注意深く従うことになるでしょう。