それが起こるかどうかは明らかではありませんでした。実際、私は個人的にそれに賭けていませんでしたが、 Appleのデザインは不可解であり、ついに新製品の発売がありました:第10世代インテルを搭載したMacBook Airの本格的なリニューアルプロセッサーの搭載、SSD の基本ストレージの 2 倍化とシザー Magic Keyboard への変更、ストレージを 2 倍にしたMac mini のリニューアル、そして目玉となる新しい iPad Pro の発売です。

さらに詳しく知りたい場合は、新しい A12Z CPU や、iPad を磁石で浮かせた状態に保つトラックパッド付きの素晴らしいキーボード ケースなど、当社の同僚が書いた記事を読んでください。新しいリアカメラに焦点を当てます。ただし、iPhone 11 のような広角カメラや超広角カメラには対応していません。もう 1 つの主役である、LiDAR テクノロジーまたはレーザー イメージング検出および測距を備えた 3D センサーについて話しましょう。それは何で、何のためにあるのでしょうか?

LiDAR、レーザー光センサー

LiDAR テクノロジーは、レーザー放射点に対する要素 (表面) の距離を知ることを可能にする点群を迅速に取得するために、専門分野で広く使用されています。このシステムは、パルスレーザー光のビームを発射し、そのビームの反射がセンサーによって捕捉される時間を測定するだけの単純なものです。

Apple が新しい iPad Pro の広告で述べているように、レーザーはナノ秒単位の光子レベル (光の光子) で動作します。これは、非常に高速なスキャナーであり、光ビームを 1 回転させてほぼすべてのデータを測定することを意味します。瞬間的な距離。

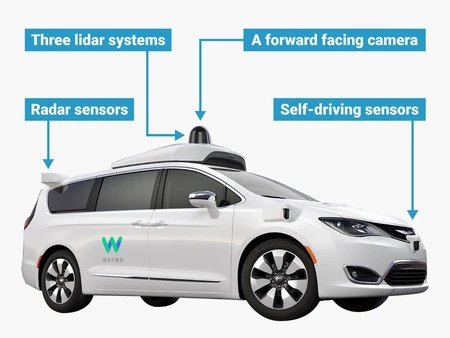

LiDAR は、あらゆる地形の 3D 詳細を高速で取得できるため、大気物理学、地質学、地震学で広く使用されているテクノロジーです。しかし近年では、自動運転車が周囲の 360 度の詳細な画像を取得するためにこの技術を利用するようになりました。 Google の Waymo 車は、このタイプのセンサーを使用して、周囲の状況と車からの各要素の距離に関する情報を即座に取得します。

iPad の場合、 LiDAR は屋外と屋内の両方で、深さ 5 メートルのポイント マップを反射して取得できます。これにより、ほぼすべての部屋、教室、または近くの空間で、近くのオブジェクトの正確な読み取り値を取得し、取得した深度マップを使用して、より優れた拡張現実体験を実現することができます。

コンピュータビジョンからレーザー光までの拡張現実

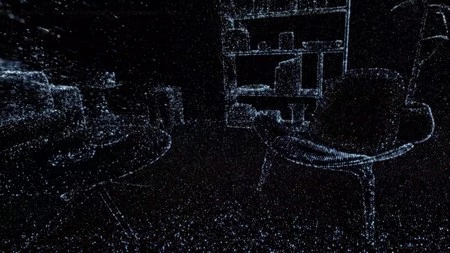

拡張現実では現在、機械学習に基づくコンピュータ ビジョン エンジンを使用して、カメラがレンズを通して見たものを解釈していることを少し前にお伝えしました。この解釈は、「カメラが見ているもの」のさまざまな場所で光がどのように屈折するかに基づいているため、デバイスは深度マップを推定し、そこから関数点 (または特徴点) を導き出します。これらの関数ポイントは、実際の要素に対応する 3D 空間内の場所であり、認識された X、Y、Z 座標に固定されています。

3D空間上で特徴点を固定した瞬間、カメラを動かしても、その点は現実世界と連動した拡張現実空間内で仮想的なアンカーポイントであるかのように移動します。

明らかに、十分な光がない場合、または表面上での光の屈折に目立った違いがない平らすぎる色の表面がある場合、コンピュータ ビジョン アルゴリズムはその表面を検出したり、ターゲットまでの距離を推定したりすることができません。カメラで特徴点を配置します。しかし、平面構造上に多くのものが検出された場合は、垂直面または水平面を検出し、それをシーン内に仮想的に配置します。

コンピューター ビジョンがシーンを推定し、3D で機能点または平面を認識すると、それらの点に接続する 3D 要素 (オブジェクト) を配置し、現実世界の上の仮想環境に実際に吊り下げられたり配置されたりする感覚を得ることができます。

しかし、LiDAR はコンピューター ビジョンを使用しなくなったため、さらに一歩進んでいます。すでに述べたように、コンピューター ビジョンは多くの場合 100% 効果的ではなく、明るい場所に依存します。これで、アプリは完全に本物の 3D 距離推定マップを取得できるようになります。 LiDAR を使用すると、カメラの前にある要素や表面を正確に検出し、仮想 3D 要素として再作成できます。

それが拡張現実の背後にある魔法のトリックです。 3D オブジェクトを平面上に配置するときは、テクスチャを持たない (透明な) 3D 平面上に配置しますが、その位置は実際の平面と一致します。本物のテーブルの上に仮想の花瓶を置いたように思っていますが、実際には、位置とサイズが本物のテーブルと一致する透明な 3D 平面上でそれを行っています。

これらの動作ダイナミクスに基づいて、新しい LIDAR センサーを使用すると、環境の 3D 表現を絶対的な精度で取得できるようになり、実際の環境の上に仮想の「透明な」体積の等価性が作成されます。したがって、仮想オブジェクトを上記の環境に置くと、ソファ、床、テーブル、またはその他の要素を仮想世界の一部として認識します(現実世界の仮想世界における鏡像表現と呼ぶことができます)。シーンに存在する実際の要素を完全な精度で考慮に入れて、実際に感じている感覚を得ることができます。

ずっと先の未来

この LiDAR テクノロジーを使用してアプリ内の 3D「ミラー次元」で実際の環境を作成すると、コンピューター ビジョン アルゴリズムを使用しないため、この環境を管理するための処理の必要性がはるかに低くなり、これによりグラフィック品質やグラフィック品質を向上させることができます。環境のリアリズム。リアルタイムでのシーンの解釈に GPU を費やすのではなく、GPU を活用してグラフィック品質を向上させます。

そして何よりも、LiDAR は ARKit (Apple の拡張現実ライブラリ) を通じてシーンの構築に役立つため、開発者はそれを統合するために何もする必要がありません。それは私たちにとって完全に透過的です。簡単に言えば、環境は新しいレーザーだけでより正確に構築されます。

一方で、Apple が将来 iPadOS 14 で、このスキャナをより高いレベルで処理できるようにし、あらゆるオブジェクトのポータブル 3D スキャナとして機能し、記録できるAPI を許可する可能性も排除しません。オブジェクトの周囲の 3D ボリュームとテクスチャを 1 回の操作で作成します。もちろん、私たちに提供される可能性は刺激的で、非常に創造的です。

さらに、この LiDAR テクノロジーは、写真レンズの穴ほどの小さなスペースで、 Apple の将来の拡張現実ヘルメットやメガネに付属し、私たちの体験をさらに統合すると考えられています。噂に注意すれば、新しいiPhone 12 Proにも搭載される可能性があるということは、まだ革命の始まりを垣間見ただけだ。