Apple は静かに、ゆっくりと、しかし確実に一歩を踏み出し続けています。拡張現実の将来と、その実装を誰でも利用できるようにするためのステップ。現在のポインティング デバイス、タッチ デバイス、または音声と同様に、近い将来、拡張現実を別のユーザー インターフェイスにするためのステップ。

最後のステップは、 すでにお伝えしたように、 Reality Converter アプリが起動されたときです。この発表は、 Apple の拡張現実エコシステム、その現状、そして起こり得る将来について話す口実として機能します。

拡張現実用の ARKit ライブラリの 3 つのバージョンを検討しただけでなく、今年は、拡張現実エクスペリエンスの作成を大幅に容易にする新しいライブラリとアプリの形で 2 つの非常に重要な追加が行われました。RealityKitライブラリとReality Composer アプリ(iPad および Mac 用のバージョンもあります)。

私たちは、拡張現実の世界を攻撃するために Apple が現在公開しているすべてのツールとアプリをレビューするつもりです。

ARKit、オリジナルのライブラリ

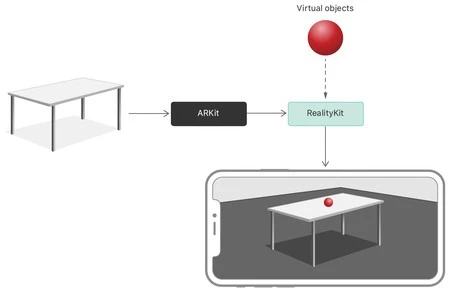

ARKit は Apple の拡張現実ライブラリです。これは Objective-C で開発されたライブラリで、iOS および iPadOS システムに統合されており、その目的は、デバイスのカメラやセンサーを通じてキャプチャされた現実に関する情報を提供することです。

ARKit ライブラリは何かをペイントする機能はありません。その機能は、デバイスのモーション センサーにリンクされたカメラを通じて受信するデータを 1 秒あたり 60 回収集することです。このようにして、ARKit は、モバイルまたはタブレットが x、y、z 軸 (水平、垂直、奥行き) でどのように動いたかを通知します。拡張現実セッションが開始されると、デバイスが存在するポイントは 0,0,0 であり、そこから値が加算または減算されるため、デバイスがどのように移動するかがわかります。

また、軸上の回転データも提供されるため、デバイスの 360 度の傾斜レベルがわかります。このデータの合計により、デバイスの動きと対照的に拡張現実要素を変換するのに十分な情報を得ることができ、これにより、オブジェクトがそこにあるという感覚を得ることができます。

しかし、理解する必要がある重要なことは、このすべての情報が 3D グラフィックス ライブラリで使用され、カメラでキャプチャされたフレーム上に拡張現実の要素が描画されるということです。すべて ARKit によって提供される情報に基づいています。そのため、このライブラリは Apple の 3D グラフィックス用ネイティブ API、SceneKit と互換性があるだけではありません。これは、ネイティブの低レベル API である Metal や、ビデオ ゲーム作成 IDE である Unreal Engine や Unity のライブラリなどの他のサードパーティ ライブラリでも同様です。

ARKit の 3 年間の進化

ARKit の最初のバージョンは、他の自尊心のあるライブラリと同様に、最初の武器と意図を示し、そこから作業するための基礎を作成しました。最初のバージョンでは、テーブルや床などの水平面の検出にすべてが機能し、領域内の関数ポイントの蓄積により、その表面が検出されたとみなされました。

平面が検出されたら、その上に 3D オブジェクトを配置することができ、オブジェクトとの視覚的な一貫性が保証されます。関数ポイントを組み合わせて要素を配置し、平面を検出することは、ARKit が最初のアプローチで提供したあらゆる可能性でした。また、FaceID センサーを使用して顔をリアルタイムでキャプチャし、その 3D マップを取得することもできます。それがアニ文字の基本です。

数か月後、ARKit 1.5 が到着しました。新しいステップ:垂直面の検出と参照画像の検出が追加されました。このようにして、コンピュータ ビジョンを通じてテクスチャをロードし、そのテクスチャを 3D 空間で特定し、オブジェクトを配置したり、その上に 3D オブジェクトとしてテクスチャを配置したりするための作業**が可能な平面を作成できるようになります**。 。

iOS 12 には ARKit 2.0 が付属します。一般的なパフォーマンスの向上、カメラ ウィンドウの 720p からより強力なデバイスでの 1080p への品質の向上、および共有エクスペリエンスが予定されています。このシステムは、以前に登録した 3D オブジェクトだけでなく、すでに行ったことのあるシーンも認識することができます (検出されたシーンの情報を 3D で記録できるため)。

WiFi または Bluetooth を使用すると、デバイス間でリアルタイム データを共有するネットワークを作成し、拡張現実シーンがその情報を他のデバイスやイベントと共有できるようになります。このようにして、複数の人が (インターネット接続を必要とせずに) 異なるデバイスや視点から同じ拡張現実体験を見ることができます。

iOS 13 には ARKit 3.0 が付属します。機能は増え続けています。人々のオクルージョンにより、カメラの前に誰かがいてその後ろに仮想オブジェクトがある場合、論理的には前に誰かがいるために描画されません。また、最も純粋な映画スタイルでのモーション検出も可能です。 ARKit の最初のバージョンに含まれていたように、50 を超えるランドマークによる単なる顔の表情検出ではなくなりました。

ARKit 3.0 を使用すると、人物を検出し、ボーン ポイントと回転を含む 3D スケルトン マップを取得し、3D デザインの標準である同じ骨格の動きの基礎を備えた任意の 3D オブジェクトでそれを複製できます。

顔のキャプチャ容量は一度に最大 3 人の顔まで増加し、背面カメラと前面カメラを同時に使用する共同エクスペリエンスと、デバイスにすでにロードされているシーンを表示したときに表示される速度と効率を表す共同セッションを使用できます。体験の始まり。

さらに、最大 100 枚の静止画像を検出できます。これには機械学習が使用されるようになり、検出が高速化され、3D オブジェクトの検出が改善され、より大きなオブジェクトをより高い精度でサポートできるようになりました。

しかし、ARKit 3 のリリースはこれで終わりではなく、新しいライブラリであるRealityKit と新しいアプリ Reality Composerもリリースされました。

RealityKit、プログラミングなしでシーンを作成

RealityKit は、Swift にネイティブな新しいライブラリであり、 ARKit 情報を使用して SceneKit ライブラリ (つまり Metal を使用) に接続します。

拡張現実体験を作成する際に最も複雑なことの 1 つは、シーン自体を設定することです。 3D オブジェクトのインポート、配置、光の当て、インタラクティブ性 (タッチなど) の作成、アニメーション…これらすべては、SceneKit ライブラリ (基本的にはビデオ ゲーム用の 3D プログラミング) を使用したプログラミングによって実行する必要がありました。 )、このタイプのアプリへの参入が困難になっていました。

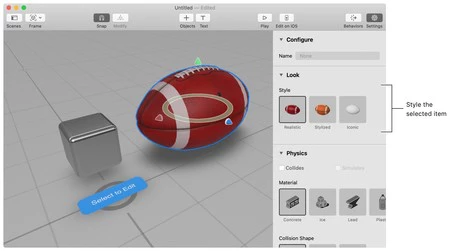

ただし、RealityKit とともに、グラフィック アプリでシーンを構成できる Reality Composer アプリがあります。シーンの作成、オブジェクトのインポート、インタラクティブ性の付与、アニメーションの付与、イベントへの応答、物理的な構成など、プログラミングで行う必要があったすべてを、よりシンプルなアプリから、コードを 1 行も記述することなく行うことができます。 。

RealityKit は Reality Composer で作成されたシーンをロードするライブラリであり、わずか数行のコードで拡張現実エクスペリエンスを起動して実行できるようになります。

リアリティ コンバーター、3D オブジェクトを変換します

SceneKitフレームワークを使用して Reality Composer と Xcode が受け入れる 3D 形式は、Collada (拡張子 .obj を持つオープン形式) またはシーンに使用されるネイティブ形式 USDZです。この形式は、Pixar がその仕事のために作成したもので、Apple も Web に投稿して Safari から直接表示できる拡張現実オブジェクトに使用している標準です。

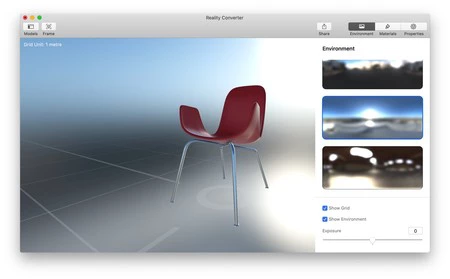

しかし、3D で作業する多くのデザイナーは、そのタスクに使用するプログラムに大きく依存するため、これらの形式を使用しません。ここでリアリティコンバーターが登場します。基本的に、 FBX などの他の標準の 3D オブジェクトやシーンを読み込むことができるプログラムです。

Reality Converter は単純なコンバーターとして設計されていません。その中で、変換されるオブジェクトを詳細に確認し、それらを自由に変更し、興味のあるものをすべて USDZ 形式に変換することができます。 .gltf や .usd だけでなく、編集できるように .obj もサポートしています。

ヘルメットとレンズの準備はすべて完了

iOS 11 での ARKit の発売以来今日に至るまでの ARKit の進化を分析すると、 Apple がこのタイプのエクスペリエンスに基づいて完全な開発環境を生成し、ほぼすべてのタイプのユースケースをカバーし、信じられないほどのパレットを提供してきたことが明確にわかります。開発者にとっての可能性。

最終的な目標は、iPhone や iPad を、エンターテインメント、教育、専門用途などの拡張現実ツールとして使用することだけではありません。本当の目標はヘルメットと拡張現実メガネです。このテクノロジーが私たちに日常的に寄り添い、リアルタイムの情報とのインタラクションを一歩超えた楽しみをもたらしてくれますように。

矢印でマークされたルート、製品とそのオファーに関する即時情報、あらゆる種類の名所からのリアルタイム データ、インタラクティブな博物館、自宅での仮想アドバイザーによる没入型のオンラインショッピング エクスペリエンス…それらが再定義する何百万もの可能性私たちが情報とどのように対話するか。

これらすべてに、(噂によると) 新しい iPad Pro に搭載される背面 3D 深度センサーという次のステップを追加すると、ユーザー エクスペリエンスの新しい世界に入るためにすべてが整います。

未来はすぐそこまで来ており、Apple は少しずつ一歩ずつ私たち開発者に進むべき道を教えてくれています。間違いなく、エキサイティングな未来です。