新しいiPhoneがあります。そして、彼らのプレゼンテーションは(ポッドキャストで私がすでに推測し、予想していたように)主に新しいカメラとその機能に焦点を当てていました。 「スローフィー」という新しい用語も学びました。しかし、新しい iPhone のカメラの真の革新性 (そして、これは最後の世代の iPhone の場合にも当てはまります)、そしてこれらのカメラの優れた性能を可能にしているのは、カメラではなく、 A13 Bionic プロセッサとそのコンポーネント。

この記事では、コンピューテーショナル フォトグラフィーとは何かを分析します。物理的に目立った革新性を持たないカメラでも、並外れた結果を達成できるようにする背後にある魔法。

問題はカメラではなく、チップとソフトウェアです

私たちはデバイスのカメラについて話すことが多いです。そのような携帯電話のカメラが他のものよりも優れている場合はどうなるでしょうか。 Pixel が iPhone よりも優れているとしたら、Huawei はある意味で Pixel よりも優れているということ…私たちはすべてを間違っています。物理的に言えば、カメラはほとんど同じであり、はるか昔に技術革新のピークに達しました。カメラ、つまり物理的なカメラ デバイスは情報をキャプチャするだけであり、その点ではすべての携帯電話はほぼ同じです。

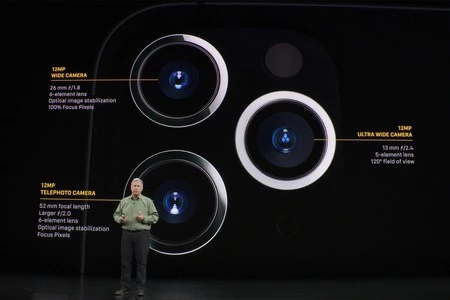

AppleはiPhone 11と3のProモデルに2台のカメラを発表しましたが、広角カメラは前世代と同じで、同じコンポーネント、同じメガピクセル、同じ絞り、同じ焦点距離を備えています。超広角カメラは新しいので以前のモデルとの比較はできませんが、光学式手ぶれ補正を搭載せず、絞りがf/2.4と小さく(例年の望遠カメラと同じ)、5つの構成要素を備えたカメラです。代わりにレンズ6. Pro モデルの望遠カメラを見ると、これも以前のモデルと同じですが、今回は絞りが f/2.4 から f/2.0 に向上するため、焦点距離を維持しながらより明るくなります。

これが言いたいのは、カメラは優れているが、物理的なレベルでの改善の範囲は最小限であるか、存在しないということです。私は、特定の特性を持つハードウェアコンポーネントとしてのみ、または厳密にそれを主張します。では、なぜ新しい iPhone は素晴らしい写真を撮るのでしょうか? A13 Bionic プロセッサとコンピュテーショナル フォトグラフィーの使用による。ここ数年、写真の革新はカメラにはありませんでした。それは写真を処理するソフトウェアとハードウェアにあります。この魔法を実現するのは、Google の驚異的なアルゴリズム (Google カメラ アプリの Pixel にのみ搭載されています) です。レンズから得られる情報を絞り出し、携帯電話で有名なポートレート モードやナイト モードを実現する処理です。したがって、違いを生むのは、携帯電話のチップのソフトウェアと処理能力です。

新しい iPhone の場合、イノベーションは A13 Bionic チップとその新しいコンポーネントにあります。写真だけに焦点を当てると、新しい A13 には、写真ごとに実行される 10 億を超える操作を処理するための特定のコンポーネントが備わっています。具体的には、HDR モードの処理を専門に担当するチップが搭載されています。また、写真の融合を計算により計算するための特別なコンポーネントと、写真の奥行き計算エンジンも備えています。さらに、ニューラル エンジンを使用して写真の意味を理解し、写真に変更をインテリジェントに適用します。

iPhone で写真を加工する (撮影ではない) 方法は次のとおりです。

Apple が挙げた例を見てみましょう。後ろに光源があると顔が暗く見える女の子の写真 (ポートレート) です。コンピューテーショナル フォトグラフィーと機械学習の新しいプロセスには、セマンティック圧縮による画像の理解が組み込まれています。つまり、ソフトウェアは(ハードウェアの助けを借りて) 写真に含まれる内容を認識します。

プロセッサは、それがポートレートであることを検出し、ポートレートを撮影した人物を検出し、その顔とその一部を検出します。顔が隠れていて、画像がオフセットされていないことを検出します。そのため、画像信号プロセッサ (ISP、A13 Bionic の別のコンポーネント) は、レンズが撮影した 8 枚の写真 (メイン 4 枚とセカンダリ 4 枚) のうち、最も露出されたショットのピクセルの情報を取得します。カメラのシャッターを押すたびに、携帯電話は 8 枚の写真を撮影します。そのうち 4 枚は HDR 用に最も暗いものから最も明るいものまで異なる露出で撮影され、その後、正しい露出、ホワイト バランス、フォーカス、トーン マップを計算するために別の 4 つの二次写真が撮影されます。露出が大きいものについては、明るさの詳細も計算されます。

このすべての情報を使用して、すべての情報を 1 つの画像に融合します。しかし、新しい A13 は、このプロセスに (XS、XS Max、XR が A12 Bionic ですでに行ったことと同様)、機械学習のさらに 4 つの層 (顔検出、顔の特徴、画像セグメンテーション マスク、画像のセマンティクス) を組み込んでいます (理解してください)。そこに表示されるもの)。

このようにして、最高露出の写真で撮影されたピクセルを結合することによって、人物の顔 (目、鼻、口、顔の楕円形などが理解および配置されている場所) がもう少し明るくなり、顔にあらゆるものが反映されます。これらの特性の写真の通常のエラーをリアルタイムで詳細に修正します。これはカメラによって行われるのではなく、ソフトウェアと A13 Bionic コンポーネントの使用によって行われます。

写真を暗くしたときにノイズがあまり出ないようにレンズを改善すればよいのではないかという意見もあります。それは問題ではありません。新しい A13 Bionic チップにより、ナイト モードでの写真撮影が可能になります。写真を撮ると、iPhone は写真をうまく撮るには光が足りないことを自動的に検出し、モードを変更してナイトモードで撮影します。

どのように機能するのでしょうか?システムは、画像の結合にかかる時間を決定し、カメラがプレビューモードで認識した内容に基づいて、写真の撮影にかかる時間の適応範囲を使用します。やろうとしていることが静止している場合、長時間露光は少なくて済みますが、動いている場合は、光を捉えるさまざまな方法で短いショットが必要になります。より多くの影がある場合、より多くの情報をキャプチャして情報を統合します。これらはすべて、写真撮影時にレンズが動かないようにするための光学スタビライザーを使用しています。

このように、ナイトモードは、露出、時間、フレーミングなどを調整することで、撮影したいものに適応します。露出によって写真がぼやけたり、ノイズが増えたりする場合は、修正してください。そのために何をしますか?異なる露出を組み合わせて情報を抽出し、情報を融合し、ノイズリダクションを適用して最高品質のショットを探し、機械学習によって要素を認識します。また、暗い部分の露出が短い写真については、最もぼやけの少ない画像がどのようなものであるかを認識し、それらの詳細を最終画像に適用して、ピクセルをブレンドすることでショット内の動きを軽減します。

最終的に得られるのは、デバイスが写真を調整し、最も暗い領域を破棄し、最も明るい領域からの情報を使用して写真を改善し、コントラストと色のバランスを取り、ノイズを低減したということです。すべて後処理で。ハードウェアとソフトウェアのユニークな組み合わせ。明らかに、カメラはナイトモードでは写真を撮影しません。

ディープフュージョン、次のステップ

これまで説明してきたこれらのプロセスはすべて、A13 Fusion チップの ISP (画像信号プロセッサ) 間の機能の完璧な組み合わせであり、シーンのコンテンツを検出して写真を改善する機械学習を備えたニューラル エンジンによってサポートされています。しかし、Apple は昨日、コンピュテーショナル フォトグラフィーにおける次のステップを提示しました。なぜなら、これまで私たちはこれを従来のプロセスのサポートとして見てきたからです。 Deep Fusion (またはディープ フュージョン) は、プロセス全体を機械学習に委任することです。写真の後処理は、カメラから情報を受け取った後、100% 人工知能によって行われます。

Apple によれば、このモードで取得できる種類の写真はこれまで見たことがなく、写真自体ではないため、どのカメラでも撮影することは不可能です。不可能な写真を取得するのは機械学習の後処理です。カメラでそのまま撮影するには、このタイプのアルゴリズムを通じてのみ取得できます。

iPhone Pro (このモードは Pro モデル専用であるため) をこの新しいモード (まだ利用できませんが、おそらく iOS 13.2 で秋にリリースされる予定です) にすると、デバイスはいつ撮影するかを検出します。写真。そして、ボタンを押そうとした瞬間に (押す前に)、通常撮影する 8 枚の写真が撮影されます:異なる露出の 4 枚と二次情報の 4 枚です。シャッターボタンを押すと、それらはすでに撮影されており、今度は長時間露光してすべての細部をキャプチャします。これら 9 枚の写真を2,400,000 ピクセル以上のピクセルごとに比較し、それぞれの最良のバージョンを探し、それぞれの最良の結果を示す処理に 1 秒かかる画像を構成します。写真。

間違いなく、これもソフトウェアに基づいた新しくて興味深いコンセプトです。これは、イノベーションがカメラにあるのではなく、カメラが捉えたものを処理するチップとソフトウェアにあることを改めて示しています。

今後の記事では、A13 Bionicチップ、そのその他の機能、エネルギーの管理方法、機器のパフォーマンスを最適化するためのプロセス制御の決定方法、および搭載されている興味深いコンポーネントについて詳しく説明します。