先週、Apple が提示した子供たちを虐待から守るための新しい対策は、 かなりの波紋と論争を引き起こしました。 IphoneFocus.clickでは、 これらのスキャン対策が iCloud とメッセージでどのように機能するかを詳しく説明しましたが、Apple は新しい文書で多くの懸念事項に対処したいと考えています。これは、Apple プラットフォーム上で子供に適用される保護に関する質問と回答です。

子どもの安全を守り、虐待的な内容の蔓延を防ぐための措置

Apple の目標は、人々の安全を確保しながら、人々に力を与え、生活を豊かにするテクノロジーを開発することです。私たちは、コミュニケーション ツールを使用して子供たちを勧誘し搾取する犯罪者から子供たちを守り、児童性的虐待資料 (CSAM) の拡散を制限したいと考えています。

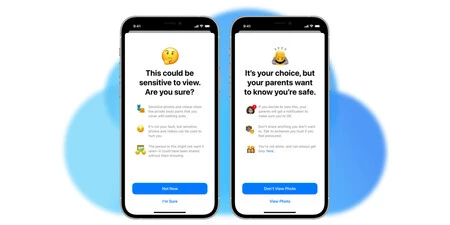

Apple のドキュメントはこのように始まります。その中で、iMessage のセキュリティと CSAM マテリアルの検出は 2 つの異なるものであり、異なるテクノロジを使用していることが明確にされている短い導入部分が見られます。同社は、最初の方法では、iMessage で送受信された画像がデバイス内で分析され、ファミリー アカウントの子供用に設定されたデバイスのみが分析されると述べています。

2 つ目は 1 つ目とは独立しており、CSAM 素材に適合する iCloud にアップロードされた写真を検出することに重点を置いており、iCloud 写真をアクティベートしていないユーザーには適用されません。この文書は非常に詳細かつ広範囲にわたるため、全文を読む価値があります。以下にできるだけ要約してみますが、必ずオリジナルを参照することをお勧めします。

iMessage 通信のセキュリティ

- iCloud でファミリーとして設定されている Apple アカウントにのみ適用されます。

- 保護者は家族グループに対してこの機能を有効にする必要があり、12 歳以下の子供に対するメッセージ アラートを受信できるのは保護者だけです。

- iMessage は Apple、NCMEC (米国児童保護協会)、または警察と情報を共有しません。

- Apple が通信にアクセスすることは決してないため、メッセージの暗号化、プライバシー、セキュリティは破られません。ユーザーは通信のコントロールを保持し、Apple は 12 歳未満の子供への性的コンテンツの通知であっても一切介入しません。

- この機能は 12 歳以下の子供にのみ存在するため、13 歳から 17 歳の子供の場合、保護者は通知を受け取りません。画像を見たいか送信したいかを決めるのは保護者であり、そうすることで保護者は通知を受け取ります。

CSAM による iCloud 写真内の不正素材の検出

- iCloud 写真スキャンの場合、 Apple はユーザーが iCloud にアップロードした写真にのみそれを適用します。これらに関して、Apple は、既知の CSAM コンテンツに適合する画像についてのみアラートを受け取ります。

- iCloud フォト ライブラリが無効になっているユーザーには適用されず、ローカルの iPhone フォト ライブラリに保存されている写真には機能しません。

- いかなる場合も、分析を実行するために CSAM 画像がデバイスにダウンロードされることはなく、CSAM である写真のハッシュのみがダウンロードされます。ハッシュは、検証された CSAM コンテンツから取得された、読み取りも再構築も不可能なこれらの画像を表す数値の文字列です。

- 分析はデバイス自体で行われ、これらのハッシュがiCloud にアップロードされた写真と比較されます。いかなる場合でも、Apple はどのような写真が iCloud にアップロードされるかを把握したり確認したりすることはありません。

- すべての写真をスキャンしてクラウドに保存する会社は他にもあります。 Apple の方法では、CSAM 画像に適合し、iCloud フォト ライブラリに含まれる写真のみに焦点を当てることでプライバシーを保護します。

CSAM 写真検出に関するその他のセキュリティ問題

Apple が発表した新しいシステムに対する不満や懸念の 1 つは、このシステムがCSAM 画像以外のものの検出に使用できるかどうかです。 CSAMハッシュと比較して複数の写真が陽性反応を示した場合には常にアラートが発生し、これは米国児童虐待センターに報告する前に人々によって分析されます。したがって、児童虐待の内容に該当する写真のみがこの組織に報告されます。

多くの人は、政府が Apple に非 CSAM 画像をリストに追加するよう強制する可能性があると主張している。クパチーノの会社は、そのような要求があった場合には拒否することを断言します。彼は、サンバーナーディーノのテロリストの iPhone 事件とFBI との対立を明確に引き合いに出し、過去に政府からの端末にバックドアを作成する要求に真っ向から反対したことがある、と明言した。

同社は、ハッシュがiPhone および iPad のオペレーティング システム自体に保存されているため、自社のシステムではアラートをトリガーするために画像を挿入することを許可していないと保証しています。特定の個人に対して攻撃を実行する可能性はなく、各レポートはその後 Apple によって手動で確認されることを覚えておく必要があります。同様に、このシステムには 10 億分の 1 の誤差があるため、無実の人々が冤罪で告発されることはあり得ません。発生した場合は、手動レビューにより除外されます。

良好なコミュニケーションがあれば避けられたかもしれない論争

もちろん、Apple がiOS 15で実施する対策は印象的です。同社は、CSAM 素材を認識するシステムと未成年者との性的コミュニケーションを防止するシステムを構築しながら、通信と写真のプライバシー、暗号化、セキュリティを維持するために多大な努力を払ってきました。それでも、ユーザーのプライバシーとセキュリティを守るという Apple の立場を考慮すると、論争が起きるのにそれほど時間はかかりませんでした。

会社とのこうした問題に関して私たちが抱いているこの高い要求は、苦労して得られたものです。しかし、これは、この問題が別の方法で処理されるべきだったということを示すものでもあります。もちろん、報道機関へのリークを許し、その後突然発表するのは得策ではありません。現在、同社はあちこちでコメントすることを余儀なくされており、多くの正当なユーザーの疑問を解決するこの文書をついにリリースしました。

これらすべての措置を事前に伝えるには、数人のジャーナリストを選ぶだけで十分だったでしょう。公式およびこれらのメディアを通じて同時に情報を公開します。新製品の分析に対する禁輸措置と同様に。

おそらく Apple は、iOS 15 やその他のオペレーティング システムの発売が近づくにつれて、同様のことを考えたと考えられます。現時点ではその必要はないと考えている。明らかになったのは、プライバシーとセキュリティの問題では、出来事を無視することはできないということです。