「人」は人類のあらゆる個人として定義されますが、 Apple Vision Proが発売されて以来、私たちは People (大文字) という新しい概念を見つけました。これは、Apple が (これも英語で) アバターと呼んでいるもので、前にカメラを持たなくてもビデオ通話を行うために Vision Pro で作成されたアバターであり、現実の人間にはまだ似ていませんが、非常に成功しています。

これは Apple が独自に発明したものではありません。Meta Quest などの他のビューアも同様のものをすでに提供していますが、 visionOS ペルソナの方が若干優れているように見えます。また、すでに Vision Pro システムに組み込まれているにもかかわらず、まだベータ版のシステムでもあるため、当時はiPhone X のアニ文字などの要素があったため、まだ改善の余地があります。

Vision Pro のペルソナとは正確には何ですか

ペルソナとは何かを正確に理解するには、Vision Pro の概念を理解する必要があります。これは、数十個のカメラと複数のセンサーを通じて、目の前に現実を表示し、その上に仮想要素を重ね合わせることができるビューアです。そして、ペルソナがどこに当てはまるかが鍵となるのは「目の前」です。

iPhone、iPad、または Mac を使用してビデオ通話を行う場合、カメラが内蔵された画面の前にいるため、他の参加者は私たちの顔を見ることができます。 Vision Pro には内部カメラがありますが、カメラは私たちの目にのみ焦点を合わせているため、ビデオ通話では顔全体を映すことさえできませんでした。目だけ。

ただし、 Vision Pro はソフトウェアを使用して、私たちの顔やジェスチャーをリアルタイムで再現できます。これを行うには、まず事前のスキャンを行って 3D モールドを作成する必要があります。つまり、頭からバイザーを取り外し、それに焦点を合わせる必要があります。

すべての特徴を含めて私たちの顔がどのようなものであるかをシステムがすでに認識したら、次はそれを現実のものにします。そこでは、リアルタイムを利用して、頭、目、眉毛、口のすべての動きをキャプチャします。また、バイザーの下部外側カバーには、口を正確に指すセンサーもあり、私たちがいつどのように動かしたかを知ることができます。

このように説明すると、簡単そうに見えるプロセスです。実際に見てみるとそう見えます。ただし、これは私たちの顔をリアルタイムでデジタル的に再現したものであり、1 秒間に何百万もの計算が行われます。そこで登場するのが、 M2 チップと R1 を筆頭としたディスプレイ ハードウェアです。

Vision Pro ビデオ通話での人の見え方

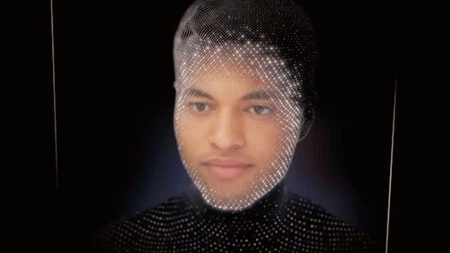

正直に言うと、これらのアバターは、カメラで捉えた現実の人間の自然さからはまだ程遠いことを認識する必要があります。これは否定できない現実ですが、Facebook (Meta) などの他の代替手段と比較して Vision Pro がどれほど正確であるかを強調することも同様に重要です。

FaceTime であろうと他のビデオ通話サービスであろうと、Vision Pro からビデオ通話に入ると必ずペルソナが表示されます。そしてまるでMacやiPhoneのカメラのように認識されます。ただし、一部のサービスではまだまったく機能しません。

視覚的には、他の人が感じるのは、デジタル実体のような雰囲気を持つ私たちのペルソナですが、それは私たちの顔に非常によく似ています。さらに、リアルタイムで私たちのジェスチャーや手にも追従します。サービスによっては、多少の遅れが生じる場合がありますが、一般的にはほとんどありません (FaceTime が最良の証拠です)。

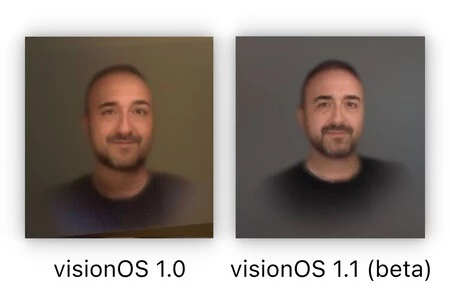

いずれにしても、最初に述べたように、これはまだ開発中の機能であり、そのためまだベータ版であることに注意してください。彼らの素晴らしい取り組みにもかかわらず、まだ改善の余地があり、今後数か月以内にすでに進歩が見られる可能性があります。これ以上は説明しませんが、visionOS 1.1 の最初のベータ版では、より自然な要素を提供することで改善されています。

Vision Pro でペルソナを設定する方法

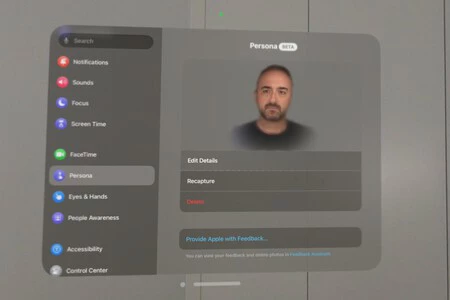

プロセスを説明したセクションでは、視聴者が必要とする事前認識についても簡単に触れました。もう少し詳しく説明すると、これは、設定を開き、ビューアで自分自身をスキャンし、再度設定するという 3 つの簡単なステップで構成されているということを説明します。

- Vision Pro をオンにすると、設定パネルに移動して「人物」セクションに入る必要があります。

- 次に、「開始」をタッチしてプロセスを開始する必要があります。

- 次に、Vision Pro を頭から取り出し、私たちに向けて (外部スクリーンが顔に面している)、音声で示されるプロセスに従います。

そして、音声でどのような指示が与えられるのでしょうか?そうですね、とりわけ、頭を向けたり、特定の顔をしたりすることです。これはすべて、カメラと 3D センサーが顔の大きさや形、ジェスチャーをキャプチャできるようにするためです。

これによると、Apple 自体が、適切な照明、よくとかしていること、髪が顔を覆わないこと、自然なジェスチャーなどを強調する一連のヒントを提供しています。これらすべては、最終的に私たちが作成する人物が可能な限り現実的で自然なものになるようにするためです。結局のところ、それは私たちがビデオ通話をするときに他の人に見えるものであり、私たちが乱れたり、非常に無理に笑顔を見せたりするのを他の人に見られたくないのです。

また、いつでもペルソナを編集したり、メガネなどのアクセサリーを追加したりすることも可能です。同様に、たとえば見た目を変更して反映させたい場合など、いつでもペルソナを再作成することができます。