Guilherme Rambo (開発者、リバース エンジニアリングの専門家、メディア 9to5Mac の編集者) がここ数か月でかなりの悪名を獲得したことは明らかです。そして、その悪名の大部分は、彼が自分の研究に基づいて情報を生成することに成功しただけでなく、私たちを興奮で満たすような小さなタッチを彼に提供するApple自体の重要な情報源も入手したことによってもたらされています。

本日、同じく有名な開発者兼研究者である Steven Troughton-Smith の協力を得て、 彼は 9to5Mac に記事を公開し、1 か月弱後に迫った次回の WWDC 2019 で開発者が目にすることになる内容の一部をプレビューしました。そして間違いなく、彼が与えた詳細は非常に興味深いものであり、開発者だけでなくユーザーも私たちが何について話しているのか、そしてこれが何を意味するのかを理解できるように、それらに名前を付けてコメントし、必要なコンテキストを追加します。の次のバージョン用にiOSとmacOS。

新しい Siri の意図

Siri ショートカットが導入されたとき、私はすでにここでレビューしており、Siri ショートカットとは正確には何なのか、つまりユーザーが何をしているかをシステムが理解できるようにする方法をアプリに提供する方法について詳しく話しました。とりわけ、その主な機能の 1 つは、オペレーティング システムが私たちが何をしているかを常に認識していることです。そしてこれを行うために、Siri の意図として知られるものを通じてそれを登録します。今日のインテンションにより、メッセージの送信、タスクの作成などのタスクを記録できるようになります。一般動詞として do、do、go に当てはまるアクション。また、表示、開く、リクエスト、注文、購入、開始、参照、共有、公開、送信、作成、追加、検索、フィルター、ダウンロード、取得、ピン留め、リクエスト、変更、チェックインなどのさまざまなセクションに分類されます。

これに加えて、インテントにより、何が行われているかをシステムに通知するだけでなく、バックグラウンドでタスクを実行することもできます。つまり、実行するためにそのアプリを開く必要のないサードパーティ アプリからのタスクです。この意味で、分析してみると、提供されたオプションはそれほど多くはありませんでしたが、Apple が予定どおりにオプションを拡張することは明らかでした。 Apple は、マルチメディア再生、検索、音声通話、イベントの発券、メッセージへの添付ファイルの添付 (ワンアクションで誰かに写真を送信するなど)、電車での旅行、飛行機、フライトの座席または搭乗ゲートの情報。これらすべてには、アプリを開かずにバックグラウンドで実行される直接の Siri ショートカット アクションを作成できるようにするための意図が含まれています。システムはこのアクティビティを記録して、私たちの行動のパターンを検出したときに提案として提供し、アプリはそれを Siri とそのショートカットの機能として提供します。

このようにして、アプリ自体を開かなくても、航空会社のアプリによって提供される直接情報として、 (たとえば)搭乗ゲートを知ることができます。 Siri が情報を教えてくれます。これが、システムとアプリがコンテキストを通じて相互に理解する方法というアイデアです。

これが拡大するのは論理的であり、おそらく最も興味深いもう 1 つのものは、Apple Music だけでなくてもよい音楽サービスと Siri をより効果的な方法で統合できるため、マルチメディア再生について述べたものです。原則として、これにより、Apple Music 以外の音楽サービスの曲を Siri に尋ねることができます。

マジパンの改良点

私たちは、Marzipan は、開発者にとってほとんど、またはほとんど労力をかけずに iOS アプリを Mac に移植できるライブラリであると考えています。そしてその通りです。しかし、マジパンはそれだけではありません。私の調査によると、 Marzipan は現在の UIKit と互換性のある新しいバージョンの UIKit で、Mac および iPad 用のアプリを構築するための新しいコンポーネントを提供します。 Gui Rambo 氏の記事で確認されているように、これらの新しいコンポーネントを使用したい場合は、Mac と iPad を同等にサポートする必要があるライブラリも必要になります。

Gui 氏によると、現在では iPhone 専用アプリから iPad もサポートするユニバーサルアプリに移行しているため、アプリを Mac に移植するには (サポートレベルで)チェックを入れるだけで済みます。それだけではなく、この新しいマジパン UIKit を使用すると、移植された iPad アプリを、タッチ バー、メニュー バーの使用、キーボード ショートカットの組み込みなどの特定の Mac 機能と統合できるようになります (これは iOS では既に実行できます)。まあ、しかし、この新しい UIKit はより Mac スタイルになり、iPad または Mac で同様に動作するでしょう)。

同様に、この新しいライブラリを使用して作成されたアプリ (システムが従来のライブラリの代わりにこの新しいライブラリを使用するように、クリックするだけで簡単にサポートできると私たちは主張しています) と、さまざまなサイズのアプリの適応型デザインを使用しています。そして制約(UI をあらゆるデバイス サイズにネイティブに適応させる方法)により、アプリが現在のように特定のサイズではなく、任意のサイズ (Mac で発生するように) を持つことができる分割画面モードをアクティブ化できるようになります。 50/50、66/33、または 25/75。現在の Mac の場合と同様に、アプリ分割バーをダブルタップするだけで位置をリセットできます。

この新しいマジパン ライブラリの登場により、 他の記事ですでに予想されているように、開発者はフローティング ウィンドウまたはパネルの新しいコンポーネントを操作できるようになります。これにより、前景の非モーダル ウィンドウが可能になり、ウィンドウを 1 つに配置することもできます。もう一方の上に置くか、画面の側面に固定して固定したままにします。コンテキスト オプションツールバーと併用する例外的な機能。

拡張現実

ARKit の「推定」バージョン 3.0 に関するニュースもあります。ARKit は、Apple のよく噂されている拡張現実メガネへの道を継続する Apple の拡張現実ライブラリです。少なくとも私にとって最も興味深いのは、 Swift でネイティブに作成されたライブラリをオペレーティング システムに直接組み込むことが不可能だったため、これまで ARKit は Objective-C ライブラリであったということです。その理由を知りたい場合は、バイナリ言語の安定性に関する私の記事をここで読んでください。

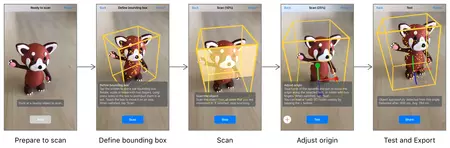

Xcode 11 および将来の iOS 13、macOS 10.15、watchOS 6、および tvOS 13 に付属するバージョンである Swift 5.1 では、モジュールのバイナリ安定性が Swift に組み込まれることがわかっています。そして最初の 1 つは ARKit で、これは Swift で完全にネイティブになります。さらに、Apple は拡張現実で視覚体験を作成するためのアプリを開発者に提供する予定です (前回の WWDC で約束しましたが、最終的にはそれがありませんでした)。

これにより、たとえば、実際のオブジェクトの 3D モデルを作成し、それを利用して 3D で検出されたオブジェクトを通じて拡張現実体験を作成できます。たとえば、モバイル、フィギュア、さらには(当時デモで見られたように)完成したレゴの家などです。このようにして、システムが以前に登録した実際のオブジェクトを認識すると、そのオブジェクトとその周囲に焦点を合わせた拡張現実体験が作成されます。

さらに、ARKit には、システムのコンピュータ ビジョン エンジン (Vision) と連携して、顔だけでなく人の姿勢を検出する機能も組み込まれます。これは、たとえば人間の動きやポーズを検出することで、それに連動したゲームや体験を可能にするなど、すでにKinectが行ってきたことの進化にほかなりません。

最後になりましたが、これまで何度もコメントしてきましたが、ビデオ ゲーム コントロール コントローラーの新しいライブラリが追加され、タッチ パッドによるコントロールもサポートされ、立体視を備えた拡張現実ヘッドセットも実際にサポートされます。

機械学習の改善

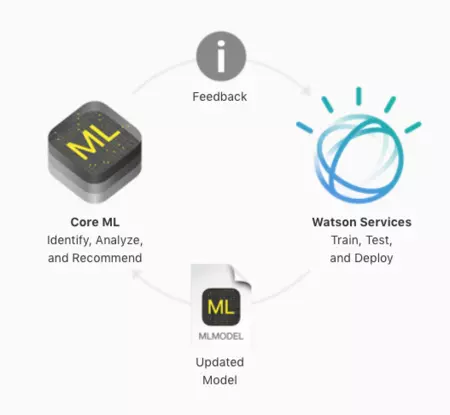

CoreML ライブラリを使用すると、以前に作成し、他のシステム (または TuriCreate や CreateML などの Apple のシステム) でトレーニングしたトレーニング済みモデルを実行できます。しかし、これらのモデルは現状のものであり、変化することはなく、その使用から得られたデータで更新することもできません。これを行うには、すべての使用状況データのフィードバックを収集し、それをクラウドまたはデバイスの外部にあるエンジンに送信して、モデルを再トレーニングする必要があります。したがって、モデルを変更するアプリを更新する場合にのみ、このアプリを更新できます。

しかし、数か月前、Apple と IBM は Swift に基づいた提携を結び、これらのモデルをクラウドに送信して再トレーニングし、アプリを更新することなくデバイスに再ダウンロードできるようにしました。しかし、これに満足せず、Apple はさらに一歩進んで、A11 および A12 チップの新機能のおかげで、CoreML モデルは、自身の使用から得られたデータをデバイス自体で直接再トレーニングできるようになりました。

このようにして、アプリを更新する必要がなく、モデルを再トレーニングすることでアプリ自体を改善、効率化し、動作を変更 (改善) できるようになります。

これに加えて、Apple はシステムにすでにロードされており、使用に応じて更新される一連の機械学習モデルを組み込む予定です。機械学習によるサウンド分析の実行を可能にするモデル、またはカテゴリ別に画像にラベルを付けるためのモデル (画像内のコンテンツを検出するため)。これにより、他のライブラリをロードすることなく Vision ライブラリからこの関数を使用できるようになります。 、アプリ内でより多くのスペースを占有します。

ハプティック エンジン、リンク、NFC など

Apple は、自社デバイスの触覚 (振動) モーターをより詳細に制御できる新しいライブラリを WWDC で発表する予定です。これにより、Nintendo Switch コントローラーと同様の方法でハプティック モーターを使用できるビデオ ゲームでも、より没入感のある体験を実現できます。

一部のライブラリまたは機能も開発者に提供され、アプリで次のことが可能になります。

- 現在の iMessage アプリの場合と同様に、アプリ内のリンクをプレビューします。

- ドキュメント スキャナー機能。このモードでカメラを開いて、複数ページのドキュメントをスキャンして PDF として返すことができます。

- 新しい API を使用すると、写真アプリを経由せずに、カメラや SD カードなどの外部デバイスから写真をキャプチャできるようになります。

- 現在 iOS 上の Files で提供されているクラウド サービスのようなストレージ プロバイダーが Mac にも登場し、 Finder と統合するためのネイティブでより効率的な方法を提供します。

- NFC ワーク ライブラリはラベル形式のサポートを強化し、 ISO7816、FeliCa、または MiFare形式を読み取れるようになります。

Apple開発者のためのクリスマス

6月にはクリスマスがやってきます。疑いはありません。 Apple は (iPad に起こる大きな変化に加えて) 非常に多くの素晴らしい小さなことをもたらすでしょう。それは、(私の生徒たちの何人かが言うように) ニューロンの液状化と脳の破裂の真の基調講演となるでしょう。

この記事では、9to5Mac ニュースにさらに背景を与え、よりアクセスしやすく、理解しやすいものにしたいと考えました。気に入っていただければ幸いです。十分ではない場合は、昨日公開されたApple コーディング ポッドキャストの最新エピソードをいつでも聞くことができます。そこでは、ここで説明した多くのことと、 iPad 用マジパンに伴う重要な変更について、さらに詳しく説明しています。