iPhone 16とiPhone 16 Pro が発売されて 1 週間が経ちましたが、詳細な分析、理論、驚きを得る時間がありました。たとえば、 iPhone 16 Pro Max のカメラがどのようなスコアを達成するか、または何を達成するかはすでにわかっています。分解した後に内部に隠された秘密。

今年の論争は、Apple の 4,800 万画素カメラとその仕組みをめぐるものです。 iPhone 14 Pro以来、メインカメラはその解像度を持っていたため、これが今起こっているのは少し奇妙です。しかし、今年は超広角カメラも Pro モデルの解像度の向上を歓迎しています。

iPhone 16 Proの48MPは偽物ですか?

YouTubeチャンネルの iPhone 16 Proのカメラを批判する動画を投稿し、その48MP解像度は「まったくの誤り」であり、実際の解像度は「約6メガピクセル」であると主張した。彼の主張にはある程度の正当性はあるものの、それはカメラセンサーの動作の部分的な解釈に基づいています。

動画では、iPhone 16 Proのカメラは「残念で誤解を招く」ものだと言及している。彼はまた、x2 ズームを批判し、品質が非常に悪いと主張しています。また、1倍ズームやメインカメラだけでなく、4800万画素の超広角レンズも搭載しているのが目立ちます。

iPhone 写真の最大手専門家の 1 人からの回答で明らかになりました。

Sebastiaan de With は、Lux の共同創設者であり、 Halide アプリの開発者の 1 人です。これは、App Store で最もダウンロードされているプロ仕様の写真アプリケーションの 1 つであり、常にイノベーションの最前線にあり、Apple が新しい iPhone を発売するとすぐに更新されます。 Apple のセンサーがどのように機能するかについての彼の知識は非常に広範であり、それが彼がこの YouTuber に対して意見の相違を表明し、48 メガピクセルのセンサーが実際にどのように機能するかを説明した理由です。

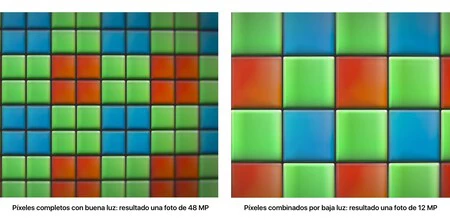

iPhone センサーは、カラー グループ化テクノロジーのおかげで 4,800 万ピクセルを備えています。センサー上の各ピクセルは特定の色を捉え、これらのピクセルのうち 4 つ (赤、緑、青) が結合されて 1 つが形成されます。最終的な画像の解像度は 12 メガピクセルですが、このテクノロジー (ピクセル ビニング) により、通常の 12 メガピクセル カメラよりも詳細な画像が得られます。結果が 6 メガピクセルのカメラの結果であるという Northrup の主張に関しては、それらは完全に誤りです。

では、48メガピクセルは何のためにあるのでしょうか?

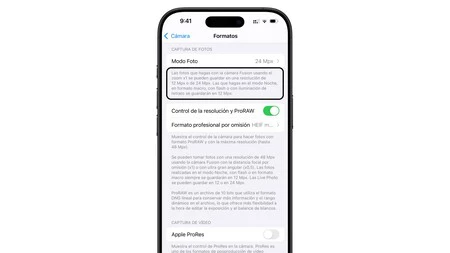

48 メガピクセルのカメラには 2 つの目的があります。それは、昼間により多くの情報を取得することです。その場合は、設定から 48 メガピクセルを有効にして、Apple ProRAW で写真を撮影できます。ただし、夜になるか屋内にいる場合、 Apple はこれらの 4,800 万ピクセルを組み合わせて、より多くの光を引き出します。結果は 12 メガピクセルの写真になります。従来の解像度ですが、48 センサーで撮影されるため、より多くの光を取り込めるという利点があります。

Apple自身も、iPhone 14 ProとiPhone 16 Proの両方の基調講演で、48メガピクセルのセンサーを超広角にすることでこれを説明しました。また、[設定] > [カメラ] > [形式] > [写真キャプチャ] 内に、これに関する詳細な説明があります。

では、Appleのカメラは偽物なのでしょうか?

それは私たちのニーズ次第です。いつでも 48 メガピクセルをアクティブにすることができますが、センサーについて少し知っていれば、スマートフォンのカメラの容量は電話の物理的なサイズによって制限されることがわかります。これが、12 メガピクセルのセンサーと同じサイズの 48 メガピクセルのセンサーが収集する光の量が少ない理由です。各ピクセルに届く光度が低いためです。明るい環境では4800万画素で撮影できるので問題ありません。しかし、照明が暗い状況では、4,800 万ピクセルを維持すると、 12 MP センサーを使用した場合よりも悪い写真が撮れてしまいます。このため、Apple (およびほとんどのメーカー) は、より良い結果を達成するためにピクセルをグループ化することを選択します。